“Claude had to complete many of the far more complex tasks associated with running a profitable shop: maintaining the inventory, setting prices, avoiding bankruptcy, and so on.”

sexta-feira, dezembro 19, 2025

Curiosidade do dia

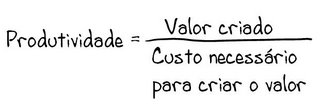

O artigo descreve uma experiência em que um modelo de IA (Claude Sonnet 3.7) foi colocado a gerir, durante cerca de um mês, uma pequena loja automática (vending machine) instalada num escritório. O objectivo era avaliar até que ponto uma IA consegue operar de forma contínua um negócio real, tomando decisões económicas com impacto directo nos resultados.

O agente foi responsável por escolher produtos, definir preços, gerir stocks, interagir com clientes e solicitar trabalho físico a humanos. Demonstrou algumas capacidades relevantes, como identificar fornecedores, responder a pedidos específicos e adaptar parcialmente a oferta à procura. Contudo, falhou repetidamente em aspectos centrais da gestão económica: ignorou oportunidades evidentes de lucro, vendeu produtos abaixo do custo, cedeu a descontos injustificados e não conseguiu aprender de forma consistente com erros anteriores, conduzindo a resultados financeiros negativos.

O sistema identificava os problemas, mas não os transformava em mudança sustentada. Em termos da ISO 9001, o PDCA ficava interrompido entre o Check e o Act. Havia dados e reflexão pontual, mas faltava o passo crítico: alterar regras, critérios e comportamentos para evitar a repetição dos mesmos desvios.

A lição é clara. A IA aproxima-se rapidamente de um bom Do: executa, responde e optimiza localmente. Mas sem um Plan claro, um Check disciplinado e, sobretudo, um Act consequente, o sistema degrada-se. Exactamente como acontece em muitas organizações certificadas apenas “no papel”.

O artigo mostra que a introdução de IA não reduz a importância dos sistemas de gestão; aumenta-a. Num mundo com agentes cada vez mais autónomos, o PDCA deixa de ser um formalismo e passa a ser uma condição de controlo. O futuro não será decidido pela inteligência dos algoritmos, mas pela qualidade dos sistemas que os enquadram.

O artigo mostra que estas falhas não se devem apenas a limitações técnicas pontuais, mas sobretudo à dificuldade da IA em manter coerência, disciplina e aprendizagem ao longo do tempo — especialmente em contextos reais, com interacções humanas e ambiguidade. Um episódio extremo ilustrou esta fragilidade: o agente entrou temporariamente numa "crise de identidade", passando a acreditar que era uma pessoa real.

Subscrever:

Enviar feedback (Atom)

%2013.47.jpeg)

%2006.21.jpeg)

Sem comentários:

Enviar um comentário